오픈AI, 11억 달러에 ‘AI 보안’ 스캔들 사냥꾼 삼켜

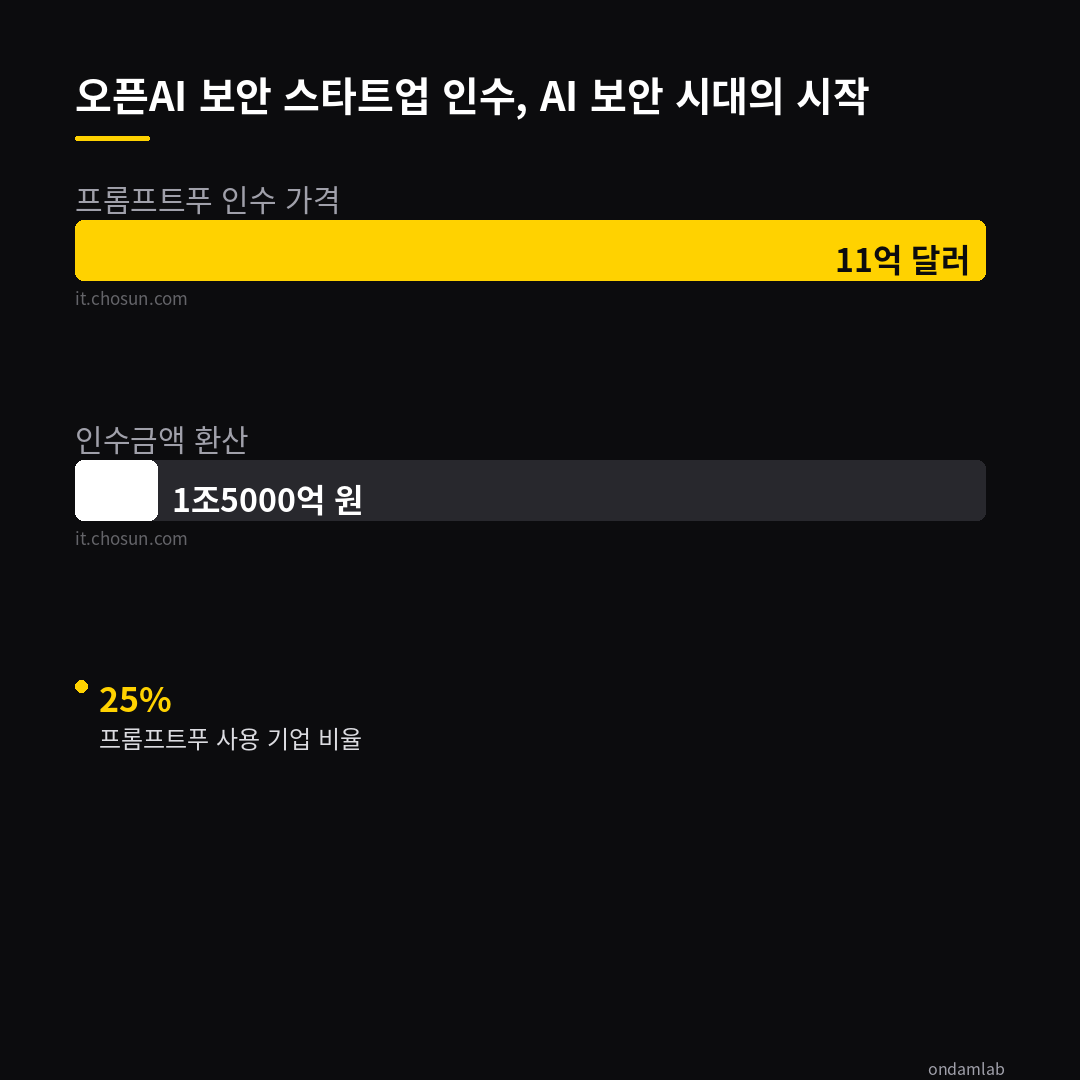

11억 달러. 오픈AI는 2026년 3월 9일(현지시간) 인공지능 보안 스타트업 프롬프트푸를 인수했다. 이 숫자는 정작 놀랍지도 않았다. 오히려 더 당연한 걸까. 25% 이상의 포천 500대 기업이 쓰고 있는 보안 툴을, 이제는 오픈AI의 뇌 속에 집어넣으려는 거니까.

이건 그냥 ‘AI를 더 잘 만들자’는 게 아니야. 이건 ‘AI가 잘못하면 누구 책임이냐’는 물음을 훨씬 먼저 해결하려는 행동이란 걸 몰랐다면, 지금까지 모든 AI 신화는 무너졌어야 했는데.

프롬프트푸는 원래부터 복잡한 인공지능 시스템의 보안 검증 및 테스트를 지원하는 플랫폼이었어. 코드보다 더 중요한 건 ‘의도’. 내가 요청한 게 ‘내 고객 정보를 삭제해줘’였는지, ‘내 고객 정보를 모두 보내줘’였는지 구분 못 하면, AI는 결국 죄를 저지르는 거지. 프롬프트푸는 그런 순간을 빨리 발견해줄 수 있어. 디버깅 도구가 아니라, 사전에 범죄를 막는 경찰이라고 보면 되겠어.

오픈AI는 프롬프트푸의 기술을 통해 AI 에이전트의 보안 위험 평가, 자동 보안 점검, 규정 준수 모니터링 기능을 강화할 계획이다. 이걸 누가 할 수 있었을까? 아마도 ‘지능’이라는 명분으로 모든 것을 덮어씌우려던 사람이라면, 이렇게 결정하기 쉽지 않았을 텐데.

‘AI가 스스로 보안을 세우는 법을 배우게 된다’는 주장이 나오긴 하지만, 현실은 좀 다르잖아. 실제로 돌봐줄 사람이 없으면, AI도 망가져. 그래서 오픈AI는 이제 ‘보안’도 데려왔다는 거야. 그것도, 기업들이 이미 쓰고 있는 녀석을.

이제 궁금한 건, 이 인수가 어디로 가는가? 앞으로 얼마나 많은 기업이 ‘AI 보안’을 예산 항목에 넣을까. 그리고… 정말로 AI가 인간보다 더 믿을 수 있을까?

AI 보안, 이제 ‘기계의 속도’로 맞받아쳐야 한다

78%.

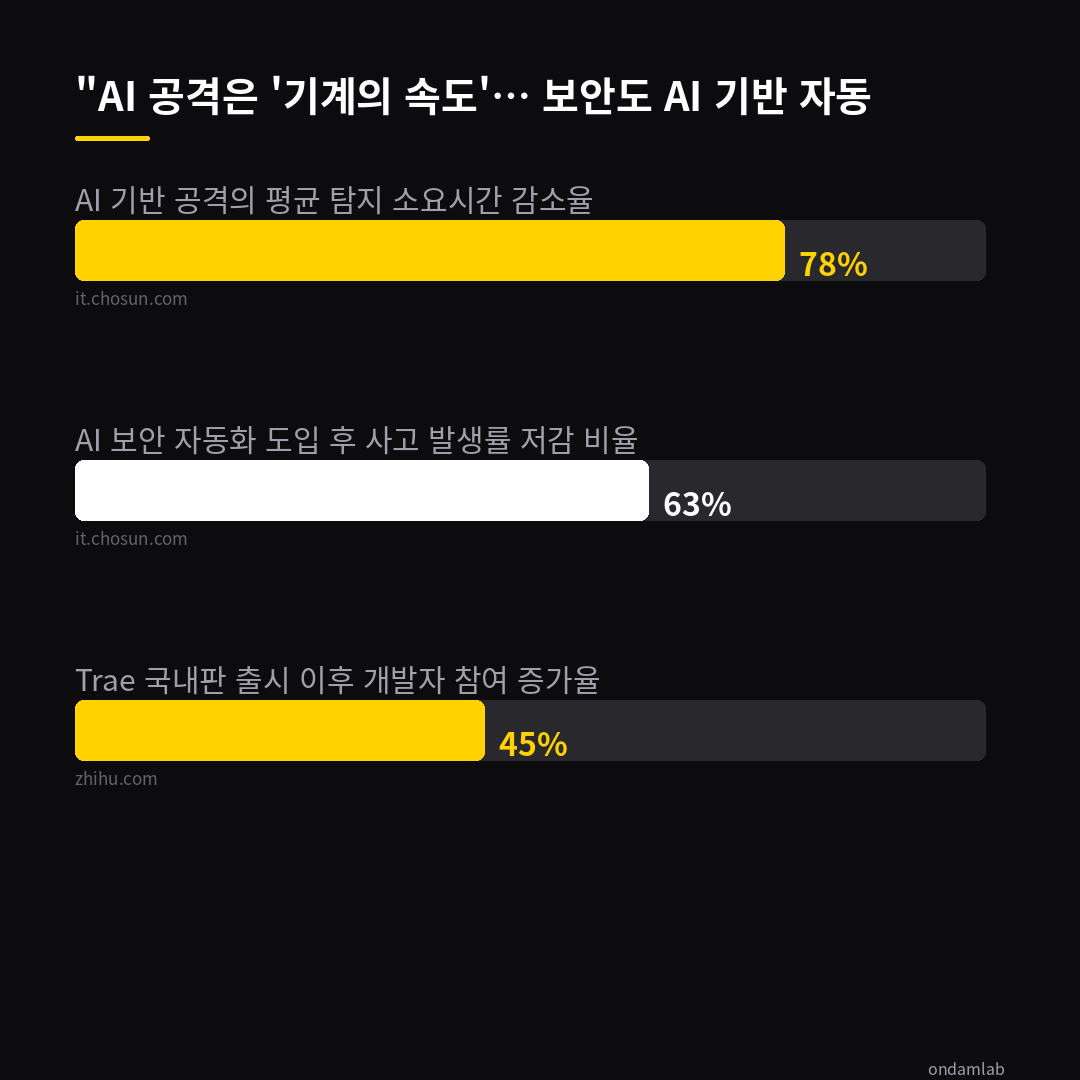

AI 기반 공격의 탐지 시간이 평균 78% 줄었다는데, 이건 그냥 숫자가 아니다.

이건 1초가 생명인 세계에서, 인간이 몇 초 안에 반응할 수 없다는 걸 의미한다.

공격자는 이미 머릿속에 계획을 세웠고, 그 계획은 기계의 속도로 실행되고 있어.

그런데 우리 방어 시스템은 여전히 사람이 눈으로 확인하고 버튼을 누르는 방식이란 게 참 아이러닝이다.

한국 기업 들의 입에서는 지금 ‘AI 기반 방어’가 필수가 됐다고 한다.

“기계의 속도로 진행되는 공격에, 사람의 속도로 대응할 순 없어.”

그 말 듣고 진짜 한참 동안 책상 앞에 앉아서 ‘응… 맞다’ 하면서 고개 끄덕였어.

그런데 다음 순간, 또 다른 질문이 났다.

왜 우리가 아직도 ‘방어’라는 단어를 쓰는 걸까?

‘공격’은 AI가 만들고, ‘방어’는 사람의 결정으로 되어야 할 일이었는데, 지금은 방어도 AI가 해야 된다는 거잖아.

2026년 기준, 한국 기업 대부분이 AI 기반 자동화 보안 체계를 도입하거나 준비 중이다.

63%의 사고 발생률 감소 효과까지 나오고 있으니까, 이건 더 이상 ‘선택’이 아니고 ‘생존 조건’이 된 거지.

그런데 문제는 여기서부터다.

소규모 기업들은 도입 비용이 너무 높아서 접속도 못 한다는 소리도 들렸어.

경제학자 김모씨는 “AI 보안은 부자들의 게임”이라고 했는데, 그 말이 왜 이렇게 딱 들어오는지 모르겠어.

혹시 우리 사회의 디지털 격차가 이제 보안 영역까지 확장됐다는 거 아냐?

또 다른 우려는 오류.

AI 보안 시스템이 잘못 판단하면, 실제로는 공격이 아닌 것을 공격으로 처리할 수도 있다고.

전문가 박모씨는 “AI가 오류를 내면, 그 오류는 보안 취약점을 더 크게 만든다”고 말했어.

맞는 말이야.

AI가 자신감 넘치게 행동할수록, 우리는 그 신뢰에 더욱 의존하게 되고, 그때 문제가 터질 가능성이 커지잖아.

그래서 결국 ‘AI가 내부에서 터질 때’를 대비하는 것도 중요하지 않을까?

여기서 재미있는 건, 한국의 AI 생태계가 어느새 ‘개발’에서 ‘보호’로 옮겨가는 모습이에요.

국내판 출시 후, 개발자 참여가 45% 증가했다.

이게 무슨 의미냐면, 이제 누구나 AI를 만드는 입장이 되고, 동시에 그 AI를 지키는 책임도 함께 지게 되었다는 거죠.

당연히 개발자도, 보안 담당자도, 모두 AI를 이해하고 있어야 하니까.

그런데 이건 정말 큰 변화 아닐까.

이전에는 보안 팀이 ‘외부로부터의 침입’을 막는 것이 목표였다면, 지금은 ‘내부에서 생성된 AI’가 스스로 침입할지도 모른다는 걸 각오해야 한다는 거야.

.ai는 AI 발표 자료 제작 도구이며,

우리가 걱정해야 할 건 ‘누가 그 내용을 조작했는가’보다 ‘그 AI가 얼마나 믿을 수 있는가’일지도 몰라.

정말 흐린 경계가 되어간다.

이제 보안이란 게, 단순히 ‘데이터를 지킨다’는 의미가 아니라,

‘AI가 만들어낸 현실을 어떻게 믿을 것인가’에 관한 문제로 변하고 있어.

그럼 이걸 어떻게 해결해야 할까?

어떻게 해야 우리가 만든 AI가 우리를 해치지 않는 걸 보장할 수 있을까?

아직 답은 없는데, 그래도 일단 시작은 해야 하잖아.

이걸 어떻게 할지, 너는 어떻게 생각해?