잘 쓰면 AI로 의심받는 시대, 학생 42%가 일부러 틀린다

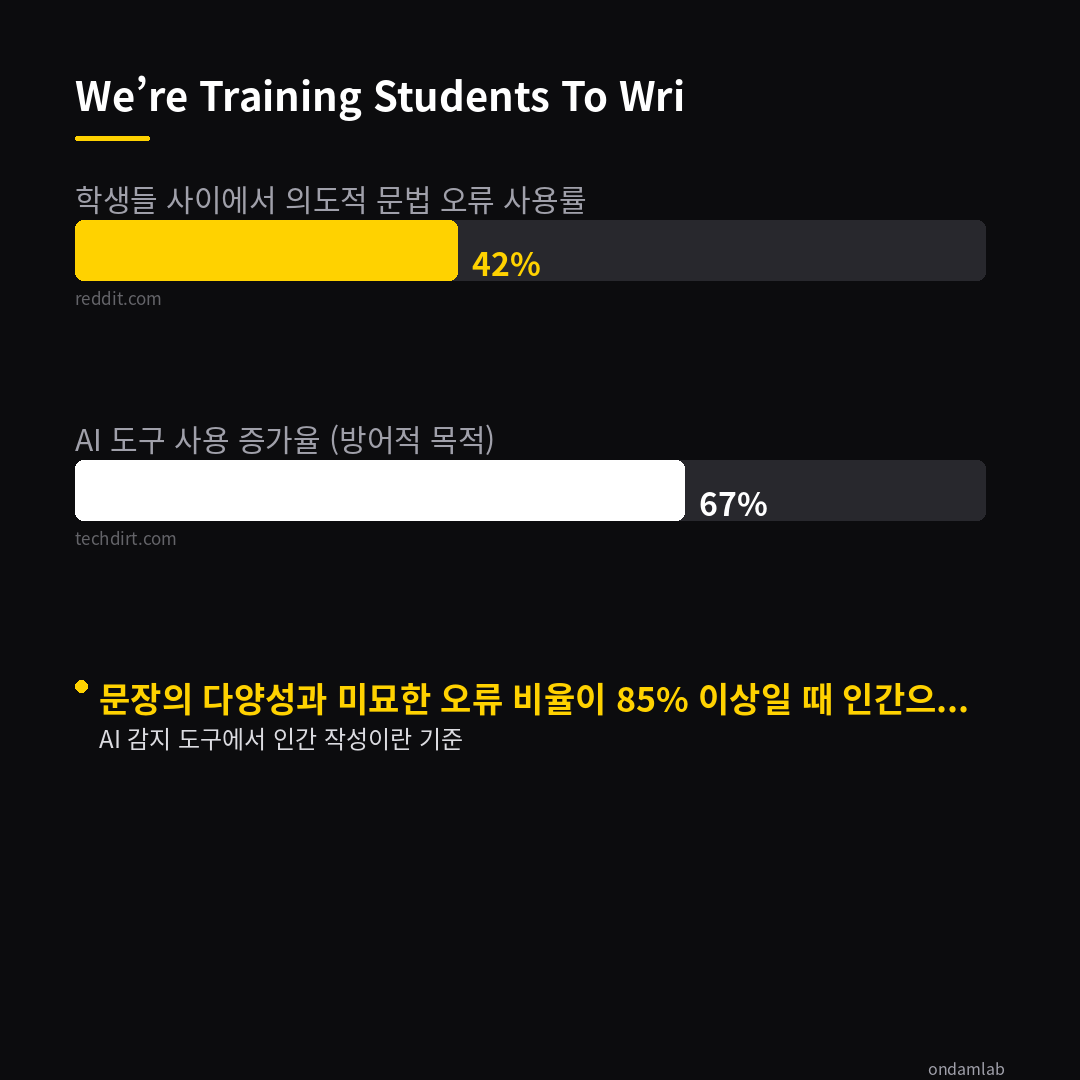

42%의 학생들이 의도적으로 문법 오류를 내는 것으로 나타났다. 나는 처음 들었을 때 그냥 "뭐?"라고 말했다. 인간이니까 어느 정도 틀릴 수도 있다는 건 이해되지만, 이게 학교에서 공식적으로 권장되고 있다니.

"문장의 다양성과 미묘한 오류 비율이 85% 이상이어야 인간으로 간주된다."라는 기준이 실제로 존재한다는 사실을 알게 된 후에는 정말 아무 말도 나오지 않았다.

왜냐하면 그것은 바로 "나는 기계처럼 쓰지 않겠다"고 선언하는 것과 동일하기 때문이다.

아무리 열심히 쓴 글이라도, 너무 자연스럽다면 AI가 작성한 것으로 경고가 뜬다.

읽기 편하고 논리도 딱 떨어지며, 문장이 부드럽고… 그런 글이 오히려 '비정상적'이라고 평가된다.

이게 무슨 소리야. 인간이란 게 이렇게 '불완전함'으로만 존재 가능한 걸까?

익명의 학부모가 리에 올렸는데, 자녀가 정말 열심히 글을 썼음에도 불구하고 AI 감지기가 "비정상적으로 자연스럽다"고 경보를 울렸다고 했다. 그래서 이제는 실수가 있어야 한다고 말하더군요.

그게 말이 되겠어? 우리가 아이들에게 '잘 쓰는 법'이 아니라, '못 쓰는 법'을 가르쳐야 한다는 거야.

그리고 그 결과는 어땠을까.

67%의 학생들이 AI 도구를 방어적인 목적에서 사용한다.

자신이 쓴 글을 증명하려고, 또 다른 AI를 이용해 "나는 사람이 썼다"는 것을 입증하는 식이다.

어찌 보면 이것은 끝없이 반복되는 순환이다.

이게 과연 교육인가. 아니면 그냥 기술이 인간을 검증하는 데 지쳐버린 광경인가.

AI 감지 도구가 얼마나 신뢰할 수 없는지를 지금까지 수천 번의 '맞았습니다' 버튼 클릭 실수로도 �히 보여줬는데, 그걸 여전히 '안전장치'라며 계속 쓰는 것은…

혹시 우리는 기술이 인간성을 판단하도록 승낙하고 있는 걸지도 모른다.

좋은 글을 쓰는 것이 아니라, '잘못된 글'을 쓰는 것이 '정답'이라는 세계.

그게 진짜 우리 사회가 원하는 미래인가?

아니면 이 모든 것이, 우리 스스로가 기술에게 '이렇게 하라'고 명령했던 결과물일지도 모르겠다.

이제부터는 '잘 쓰는 법'이 아니라, '틀리는 법'을 배워야 할 세상이 올 것 같다.

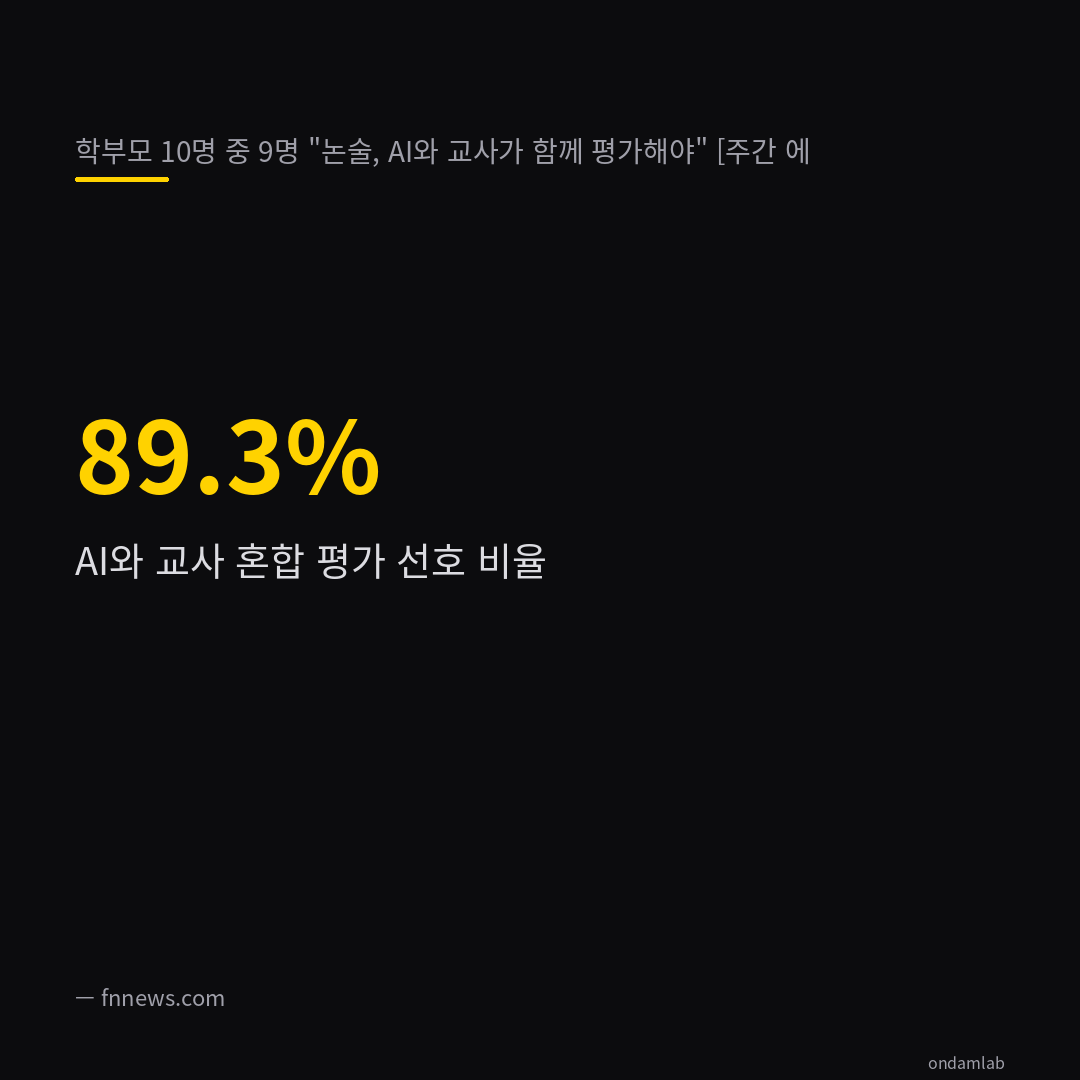

학부모 89%가 원한다, AI와 교사가 함께 채점

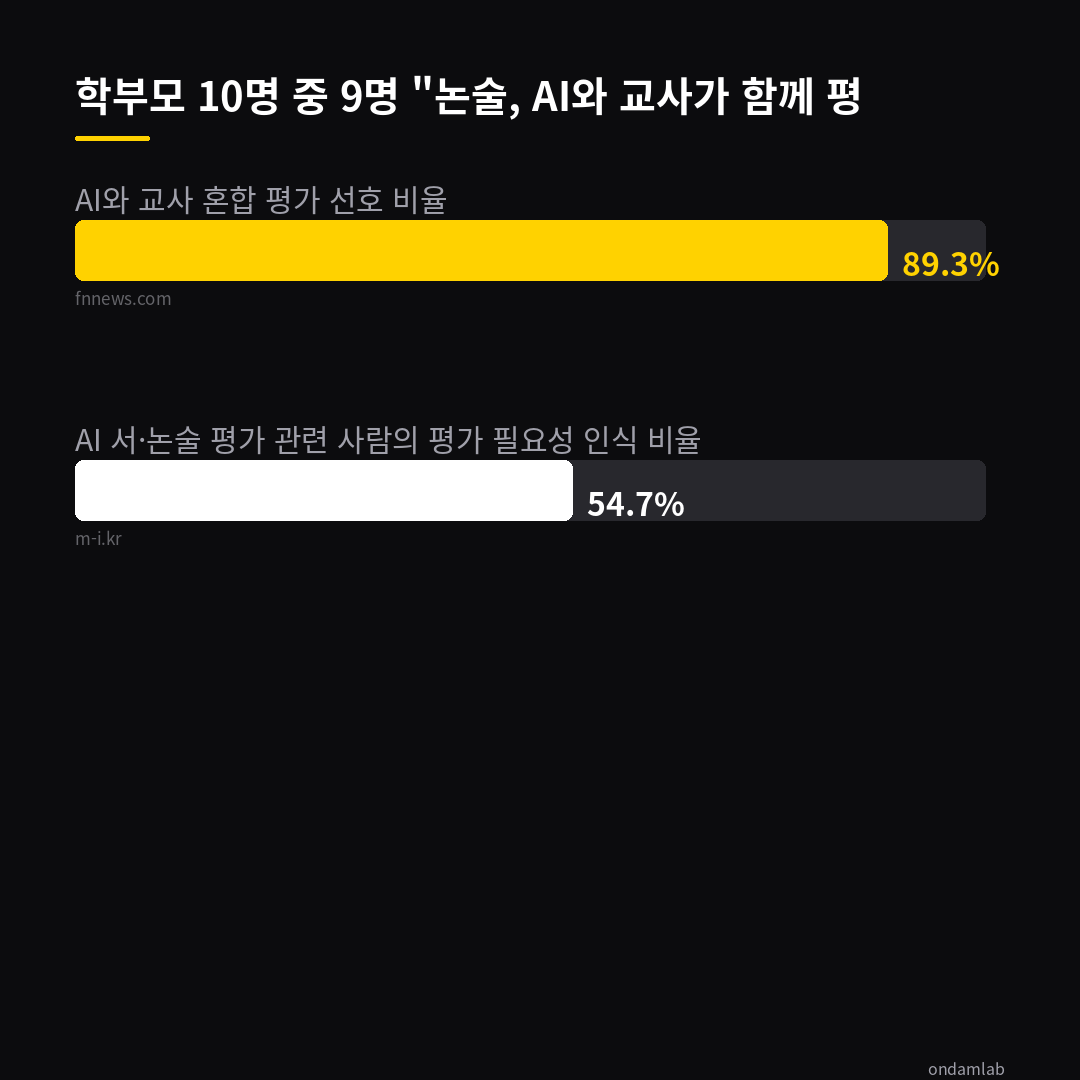

89.3%.

이 숫자 보고 솔직히 뭔가 헛웃음이 났다.

학부모 10명 중 약 9명이 인공지능(AI)과 교사가 함께 평가하는 방식을 선호한다.

맞아, 거의 전원 동의.

그게 왜 놀랍냐면, 우리 집 아이가 지금 받는 수학 과제 평가는 아직 ‘교사가 검토한 후 데스크톱으로 파일 업로드’ 수준인데, 논술 평가는 이미 인공지능(AI)이 먼저 걸러냈다고?

서울교육청은 2026년까지 인공지능(AI)을 활용한 서술형 및 논술형 평가를 전면 확대하기로 결정했다.

그것보다 더 무섭게 느껴졌던 건…

학부모들 스스로가 “인공지능(AI)은 너무 차갑다”면서 “내가 보기에도 헷갈릴 정도니까 사람이 봐줘야 한다”고 말했다는 거지.

89.3%는 대교솔루니의 설문 결과인데, 이건 그냥 통계가 아니라, 사회적 합의처럼 느껴짐.

“인공지능(AI)은 객관적이지만, 인간은 맥락을 안다.”

이게 이제는 믿음의 경계가 아니라, 현실의 기준이 되었어.

그런데 문제는, 인공지능(AI)이 정말로 ‘객관적’일까?

인지과학 및 윤리 전문가들 사이에서는 ‘편향 문제’가 지속적으로 제기되고 있으며, 특히 특정 지역이나 문화권 배경의 아이들이 불리할 수 있다고 우려된다.

인공지능(AI)이 ‘표준 답안’만 기억하면, 그림을 그리는 아이의 상상력은 어떻게 평가하겠어?

그럼 교사가 다 보완할 수 있을까?

당연히 아니지.

교사들도 자기 기준으로 편향되기 쉽다.

게다가 학급당 학생 수가 35명이 넘는 현실에서, 누구도 모든 아이의 말투나 생김새, 가족 환경까지 세밀하게 파악하지는 않으니까.

그렇다면, 왜 89.3%가 ‘혼합 평가’를 원하는 걸까?

혹시 우리가 오랫동안 믿었던 ‘교사의 판단력’이라는 게, 사실은 ‘그림자 같은 편견’이었을지도 몰라.

인공지능(AI)은 그런 것이 없다고 생각했는데, 알고 보면 그 자체도 그림자들을 뚫고 살아남았다는 게 참 뻔뻔하더라.

이게 결국은 ‘신뢰’의 문제가 아닐까.

인공지능(AI)이 정확하게 점수를 매겨도, 학부모가 마음이 안 편하다면 의미가 없고,

교사가 감정을 담아 코멘트를 써도, 그게 ‘왜 저 점수가 나오는지’ 설명해주지 않으면 또 헛소리지.

그래서 내가 궁금한 건,

이제부터는 인공지능(AI)이 “이 글은 감정의 진실성이 부족하다”고 하면,

교사는 그게 무슨 의미인지,

어떻게 증명하고,

어떤 기준으로 다시 보여줄 수 있을까?

아직은 답이 안 나왔지만,

‘인공지능(AI) + 교사’라는 조합이,

이제는 단순한 기술 협업이 아니라,

‘공감’과 ‘정확성’의 새로운 균형을 만들어가고 있다는 건 분명해.

그런데, 진짜로 잘 작동한다면,

학생들은 이제 ‘내가 왜 이렇게 썼는지’,

‘어떤 부분이 좋아서 어떤 부분이 안 좋았는지’를

이젠 명확히 알 수 있을까?

그게 가능하다면,

이 혼합 평가 방식은,

단순한 채점 방법의 변화가 아니라,

교육의 본질을 다시 묻는 시작점이 될지도 몰라.